Як новачкові створити та розпізнати діпфейк?

Технології стають дедалі кращими в моделюванні реальності. Створені за допомогою штучного інтелекту (ШІ) медіадані потрапили до заголовків відомих видань — особливо відео, де хтось говорить або робить щось, чого насправді не робив.

Група старшокласників із Нью-Йорка згенерувала ролики, на яких директор середньої школи робить расистські висловлювання і погрожує учням. У Венесуелі за допомогою ШІ створили відео для поширення політичної пропаганди. Стримера Twitch спіймали на перегляді сайту з фейковим порно-контентом із жінками-геймерами.

У всіх трьох випадках згенеровані за допомогою ШІ відео створені з метою переконати людей у тому, що хтось зробив те, чого насправді ніколи не робив.

Такий контент називається діпфейком.

Що таке діпфейк?

Діпфейк — це технологія синтезування медіаданих, на яких обличчя людини на наявних фото або відео замінюється обличчям іншої людини. При створенні підробок використовують методи штучного інтелекту, машинного навчання та нейронних мереж.

За допомогою таких систем можна синтезувати переконливі фейкові відео, фотографії та «голосові клони».

Примітка: назва технології походить від поєднання англійських термінів deep learning(глибоке навчання) і fake (підробка).

Слово «діпфейк» виникло наприкінці 2017 року. Його застосував користувач Reddit під ніком deepfakes. Він поділився АІ-відео, де «прикріпив» обличчя знаменитостей на тіла актрис у порнографічних роликах.

У той час також став популярним контент із підробленим Ніколасом Кейджем у різних фільмах, де він не знімався.

Однак deepfakes не можна вважати винахідником технології. Вона є результатом роботи безлічі дослідників та ентузіастів протягом кількох десятиліть.

Чим діпфейки відрізняються від інших видів маніпульованих медіа?

Діпфейки — це не просто фальшивий контент або контент, що вводить в оману.

Зображення Папи Римського Франциска в пуховику або нібито фото арешту колишнього президента США Дональда Трампа, які розповсюджуються незадовго до пред’явлення йому обвинувачення, створені за допомогою ШІ. Однак це не діпфейки.

Подібний контент у поєднанні з інформацією, що вводить в оману, зазвичай називають «поверхневими фейками» (shallowfakes).

Діпфейк відрізняє елемент людського внеску. Тільки наприкінці синтезу користувач вирішує, чи підходить йому результат. Він також може адаптувати навчальні дані, проте більше ніяк не впливає на алгоритм.

Як створюють діпфейки?

Існує кілька методів створення діпфейків. Найпоширеніший заснований на застосуванні глибоких нейромереж, що використовують техніку підміни облич.

Користувачеві потрібне відео, яке стане базою для діпфейка, і ролики з людиною, чиє обличчя необхідно вставити.

Медіадані не обов’язково мають перетинатися одна з одною. Основою може стати, наприклад, уривок із голлівудського фільму, а інші відео — випадкові кліпи з людиною на YouTube.

Алгоритм аналізує, який вигляд має людина з різних ракурсів і в несхожих умовах. Потім він зіставляє обличчя в цільовому відео, знаходячи спільні риси.

Для виявлення і виправлення помилок у діпфейках часто використовують генеративно-змагальні нейромережі. Це ускладнює декодування таких роликів детекторами підробок.

Хоча створення діпфейків може виявитися складним завданням, відповідне програмне забезпечення спрощує процес. Новачкам доступні додатки на кшталт Zao, DeepFace Lab, FakeApp і Face Swap. Більш просунуті користувачі можуть знайти релевантне ПЗ на сервісі GitHub.

Хто створює діпфейки?

Діпфейки можуть генерувати дослідники, інженери машинного навчання, студії візуальних ефектів, режисери та ентузіасти. Завдяки популярним застосункам на кшталт Reface будь-хто зі смартфоном здатен зробити підроблені фото або відео.

Уряди можуть задіяти технологію в рамках стратегій з дискредитації та підриву екстремістських груп або встановлення контактів із цільовими особами.

Наприклад, у 2022 році південнокорейські розробники створили діпфейк кандидата в президенти Юн Сок Еля для залучення молодих виборців напередодні виборів. Цифровий аватар схожий на реального політика і вміє жартувати.

Також діпфейки застосовують діячі мистецтва.

У жовтні 2023 року вийшов кліп на пісню «Вовча ягода» українського виконавця WELLBOY. Співак Антон Вельбой не брав участі у зйомках через розрив співпраці з лейблом, тож у ролику використовуються його діпфейк і голос.

Як використовують діпфейки?

Багато зі створених діпфейків — порнографічні. Згідно зі звітом стартапу Deeptrace, у 2019 році ролики для дорослих становили 96% з усіх підробок в інтернеті.

У червні 2023 року ФБР попередило громадськість про небезпеки генеративного ШІ та його застосування для «створення порнографічного контенту, секс-здирництва і переслідувань».

Діпфейки також використовують у злочинах несексуального характеру. Наприклад, у 2023 році зловмисники підробили голос дитини, щоб шантажувати її матір.

У січні 2020 року в ОАЕ шахраї за допомогою штучного інтелекту зімітували промову керівника великої компанії та переконали банківського працівника перевести $35 млн на їхні рахунки.

ШІ-підробки також використовують у політиці. У 2018 році бельгійська соціалістична партія опублікувала діпфейк, на якому Дональд Трамп закликає країну вийти з Паризької угоди.

Діпфейки застосовуються для інформаційних атак, створення пародій і сатири.

У 2018 році режисер Джордан Піл і видання BuzzFeed опублікували нібито звернення колишнього президента США Барака Обами, де він назвав Дональда Трампа «засранцем». Ролик створили за допомогою додатка FaceApp і графічного редактора Adobe After Effects.

Режисер і журналісти хотіли показати, який вигляд у майбутньому можуть мати фейкові новини.

У 2022 році після повномасштабного вторгнення Росії на територію України в соцмережах поширили дипфейк президента Володимира Зеленського. У ролику глава держави «закликав народ здатися».

Однак користувачі швидко визначили підробку, а Зеленський записав спростування.

6 інструментів для створення діпфейків

Зважаючи на популярність технології, в інтернеті доступно безліч ШІ-інструментів для створення фото і відео діпфейків. Їх можна використовувати в розважальних і дослідницьких цілях.

MyHeritage

Це один із найпопулярніших дипфейк-додатків на ринку. Вірусною стала функція Deep Nostalgia, яка дає змогу «оживляти» старі фото.

Користувачеві достатньо завантажити зображення і натиснути кнопку анімації.

Reface

Додаток дає змогу замінювати одне обличчя на інше у відео або GIF.

Користувачеві необхідно зробити селфі та обрати цільовий ролик. Через кілька секунд додаток запропонує готову анімацію.

Система не завжди точно зіставляє людей. Результат залежить від симетрії обличчя на фото і якості вхідних даних.

Wombo

Додаток «змушує» людей на фото співати.

Користувачеві потрібно зробити селфі і вибрати трек зі списку. Система анімує обличчя і синхронізує його губи з музичним твором.

DeepFakes Web

Сервіс дає змогу замінити обличчя однієї людини у відео на інше.

Користувачеві необхідно завантажити вихідний і цільовий ролики. Обробка відбувається в хмарі і займає близько 30 хвилин.

За необхідності користувач може підвищити якість створеного діпфейка, повторно застосовуючи навчену модель і підвищуючи якість використовуваних даних.

Synthesia

Дозволяє генерувати високоякісні фейкові відео за допомогою штучного інтелекту. Серед доступних функцій: реалістична зміна облич, синхронізація губ і клонування голосу.

Однак алгоритми Synthesia вимагають складного навчання, тому сервіс призначений для досвідчених користувачів.

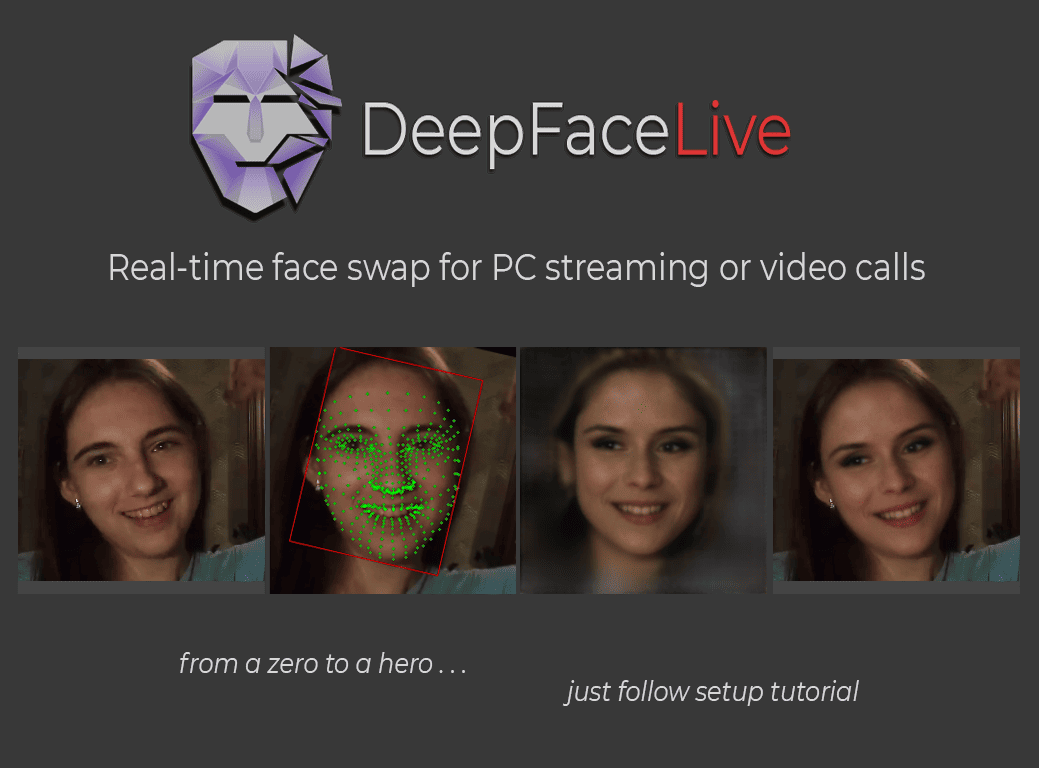

DeepFaceLive

Сервіс дає змогу підміняти обличчя користувача у відео. Він безкоштовний і доступний на GitHub.

Алгоритм працює в режимі реального часу. Він вміє накладати діпфейк під час прямих трансляцій або відеоконференцій, наприклад, у Zoom.

Для підвищення якості роботи технології користувач може налаштувати моделі вручну. Однак через відсутність докладної документації DeepFaceLive досить складний для новачків.

Програма сумісна лише з відеокартами Nvidia, починаючи від моделі GeForce GTX 750 і вище.

Як розпізнати діпфейк?

Часто підроблені фото та відео низької якості. Однак технологія розвивається і визначити діпфейки стає складніше.

Але методи виявлення підробок теж не стоять на місці. Щоб виявити діпфейк, користувачеві необхідно звернути увагу на певні деталі. Серед них:

- візуальні невідповідності на кшталт незвичних рухів тіла людини або міміки обличчя, наприклад, відсутність моргання. Може спостерігатися непослідовне освітлення або тіні, спотворені відображення на райдужній оболонці очей, мерехтіння і пікселізація по краях транспонованих граней;

- несинхронізований звук. Часто в діпфейках рух губ не збігається з промовою, що є явним індикатором підробки;

- надійність джерел медіаданих;

- контекстуальні підказки. Необхідно упевнитися в тому, чи здатна людина говорити і робити те, що демонструється у відео або на зображенні.

Також можна використовувати спеціальне програмне забезпечення для виявлення діпфейків. Такі системи за допомогою різних інструментів і методів аналізують дані на предмет маніпуляцій.

Однак подібне ПЗ не завжди надійне на 100%. Результат необхідно перевіряти ще раз. Проти дипфейків борються великі технологічні корпорації. У квітні 2022 року компанії Adobe, Microsoft, Intel та інші об’єдналися в альянс C2PA для виявлення підроблених фото і відео в інтернеті.

Шкода і користь діпфейків

Крім дезінформації, переслідувань, залякувань і принижень, дипфейки можуть підірвати довіру суспільства, коли люди не хочуть або не можуть відрізнити правду від брехні. Це може призвести до сумнівів щодо конкретних подій.

Наприклад, 2018 року міністр зв’язку Республіки Камерун назвав фейковим відео, де, на думку правозахисної організації Amnesty International, солдати страчують мирних жителів.

«Проблема полягає не стільки в підробках, скільки в тому, що справжню реальність можна правдоподібно заперечувати», — заявила експерт у сфері інтернет-права в Університеті Ньюкасла Ліліан Едвардс.

Оскільки технологія стає більш доступною, діпфейки здатні створити проблеми для судів, де фальсифіковані події можуть видаватися за докази.

Також технологія становить загрозу для особистої безпеки. Діпфейки вже вміють імітувати біометричні дані та обманювати системи розпізнавання облич, голосу або ходи.

Але, крім загроз, технологія може виявитися корисною.

Діпфейки активно використовують у розважальних цілях. Наприклад, стартап Flawless розробив систему, що дає змогу синхронізувати рух губ акторів і звукової доріжки під час дублювання фільмів різними мовами.

Користувачі публікують у соцмережах Instagram і TikTok створені через Reface уривки відомих кінокартин із заміненими обличчями персонажів.

У липні 2021 року автори документального фільму про відомого шеф-кухаря Ентоні Бурдена, який помер 2018 року, використовували діпфейк для озвучування його цитат.

Крім того, технологія здатна допомогти людям повернути голос, втрачений через хворобу.

2021 року компанія Sonantic синтезувала мову актора Вела Кілмера. Він втратив голос через рак гортані.

Також діпфейки використовують для створення синтетичних наборів даних. Це позбавляє розробників необхідності збирати фотографії реальних людей і отримувати дозволи на їх використання.

Що нас чекає в майбутньому?

Технологія продовжить розвиватися і основним напрямком стане підвищення якості підробок. Досягнення в галузях штучного інтелекту, машинного навчання і комп’ютерного зору, а також поліпшення обчислювальних потужностей призведуть до створення більш переконливого і реалістичного медіаконтенту.

Діпфейки здатні зробити революцію в індустрії розваг. Їх можна використовувати для генерації гіперреалістичних візуальних ефектів, що дасть змогу кінематографістам легко поєднувати реальних акторів із віртуальними персонажами.

Можливо, з’являться високоякісні цифрові виступи померлих знаменитостей або цікаві ігрові кросовери, створені фанатами-геймерами.

У міру розвитку технологія стане доступнішою для широкої публіки. Також збільшиться кількість інструментів і застосунків, що дають змогу всім охочим створювати ШІ-підробки.

Діпфейки відкриють нові можливості для творчості, але також призведуть до зростання випадків їх неправомірного використання, порушення конфіденційності та дезінформації.

Збільшення кількості підробок сприяє розробці якісних систем виявлення. Можливо, це також призведе до розробки або адаптації законів і правил для регулювання технології та усунення потенційної шкоди.

Висновки

Діпфейки являють собою «палицю з двома кінцями» у сфері штучного інтелекту. Хоча технологія пропонує творчі та розважальні можливості, її потенціал для неправомірного використання викликає серйозні побоювання.

У міру розвитку алгоритмів потрібно зберігати пильність і розробляти стратегії щодо пом’якшення негативних наслідків.

Підвищуючи обізнаність людей, інвестуючи в технології виявлення та реалізуючи відповідні правові та політичні заходи, суспільство зможе орієнтуватися в складному ландшафті діпфейків і зберігати довіру, безпеку та цілісність цифрового світу.

- Діпфейк — це метод створення медіаданих за допомогою алгоритмів глибокого навчання. Технологія дає змогу замінювати обличчя людини на інше на наявних фото чи відео та копіювати її голос.

- ШІ-підробки здатні генерувати як дослідники чи інженери, так і ентузіасти.

- Діпфейки можна виявити за візуальними і звуковими невідповідностями або задіюючи спеціальне ПЗ.

- Крім секс-вимагання, переслідувань, дезінформації, залякувань і принижень, діпфейки використовують у сфері розваг, синтезування даних і відновлення голосу.

- Розвиток технолгії призведе до створення більш переконливого і реалістичного фальшивого медіаконтенту. Своєю чергою, це сприяє розробці якісних систем виявлення ШІ-підробок.