Jak początkujący może stworzyć i rozpoznać deepfake?

Technologia coraz lepiej modeluje rzeczywistość. Dane medialne generowane przez sztuczną inteligencję (AI) trafiły na pierwsze strony gazet – zwłaszcza filmy, na których ktoś mówi lub robi coś, czego w rzeczywistości nie zrobił.

Grupa uczniów szkół średnich w Nowym Jorku wygenerowała filmy przedstawiające dyrektora liceum wygłaszającego rasistowskie uwagi i grożącego uczniom. W Wenezueli sztuczna inteligencja została wykorzystana do tworzenia filmów w celu szerzenia propagandy politycznej. Streamer Twitch został przyłapany na oglądaniu strony z fałszywymi treściami pornograficznymi z udziałem kobiet.

We wszystkich trzech przypadkach filmy wygenerowane przez sztuczną inteligencję zostały stworzone, aby przekonać ludzi, że ktoś zrobił coś, czego w rzeczywistości nie zrobił.

Tego rodzaju treści nazywane są deepfake.

Co to jest deepfake?

Deepfake to technika syntezy mediów, która zastępuje twarz osoby na istniejącym zdjęciu lub filmie twarzą innej osoby. Sztuczna inteligencja, uczenie maszynowe i techniki sieci neuronowych są wykorzystywane do tworzenia podróbek.

Systemy te mogą być wykorzystywane do syntezy przekonujących fałszywych filmów, zdjęć i “klonów głosowych”.

Uwaga: Nazwa technologii pochodzi od połączenia angielskich terminów deep learning i fake.

Słowo “deepfake” pojawiło się pod koniec 2017 roku. Zostało ono zastosowane przez użytkownika Reddita pod pseudonimem deepfakes. Udostępnił on wideo ze sztuczną inteligencją, w którym “przyczepił” twarze celebrytów do ciał aktorek w filmach pornograficznych.

W tym czasie popularne stały się również treści przedstawiające fałszywego Nicolasa Cage’a w różnych filmach, w których nie grał.

Jednak deepfakes nie można uznać za wynalazcę technologii. Jest ona wynikiem pracy wielu badaczy i entuzjastów na przestrzeni kilku dekad.

Czym deepfakes różnią się od innych rodzajów zmanipulowanych mediów?

Deepfake’i to nie tylko fałszywe lub wprowadzające w błąd treści.

Wizerunek papieża Franciszka w puchowej kurtce lub rzekome zdjęcie aresztowania byłego prezydenta USA Donalda Trumpa krążące na krótko przed jego oskarżeniem zostały stworzone przy pomocy sztucznej inteligencji. Nie są to jednak podróbki.

Tego rodzaju treści, w połączeniu z wprowadzającymi w błąd informacjami, są powszechnie określane jako “płytkie podróbki”.

Deepfakes charakteryzują się elementem ludzkiego wkładu. Dopiero pod koniec syntezy użytkownik decyduje, czy wynik jest dla niego odpowiedni. Może on również dostosować dane treningowe, ale nie ma już żadnego wpływu na algorytm.

Jak tworzone są deepfake’i?

Istnieje kilka metod tworzenia deepfake’ów. Najpopularniejsza z nich opiera się na zastosowaniu głębokich sieci neuronowych wykorzystujących techniki zamiany twarzy.

Użytkownik potrzebuje wideo, które będzie bazą dla deepfake’a oraz klipów osoby, której twarz ma zostać wstawiona.

Dane medialne niekoniecznie muszą się ze sobą pokrywać. Podstawą może być na przykład fragment hollywoodzkiego filmu, a pozostałe filmy mogą być losowymi klipami danej osoby na YouTube.

Algorytm analizuje wygląd osoby pod różnymi kątami i w różnych warunkach. Następnie dopasowuje twarze w docelowym filmie, znajdując podobieństwa.

Generatywno-adwersaryjne sieci neuronowe są często wykorzystywane do wykrywania i korygowania błędów w podróbkach. Utrudnia to detektorom fałszerstw dekodowanie takich filmów.

Chociaż tworzenie deepfake’ów może być zniechęcającym zadaniem, odpowiednie oprogramowanie ułatwia ten proces. Dla początkujących dostępne są aplikacje takie jak Zao, DeepFace Lab, FakeApp i Face Swap. Bardziej zaawansowani użytkownicy mogą znaleźć odpowiednie oprogramowanie na GitHub.

Kto tworzy deepfake’i?

Deepfake’i mogą być generowane przez naukowców, inżynierów uczenia maszynowego, studia efektów wizualnych, filmowców i entuzjastów. Dzięki popularnym aplikacjom, takim jak Reface, każdy, kto ma smartfona, może tworzyć fałszywe zdjęcia lub filmy.

Rządy mogą wykorzystywać technologię jako część strategii dyskredytowania i osłabiania grup ekstremistycznych lub docierania do wybranych osób.

Na przykład w 2022 r. południowokoreańscy programiści stworzyli deepface kandydata na prezydenta Yoon Seok-yeola, aby przyciągnąć młodych wyborców w okresie poprzedzającym wybory. Cyfrowy awatar przypomina prawdziwego polityka i może żartować.

Deepfake’i są również wykorzystywane przez artystów.

W październiku 2023 r. ukazał się teledysk do piosenki “Vovcha yagoda” ukraińskiego piosenkarza WELLBOY. Wokalista Anton WELLBOY nie wziął udziału w kręceniu filmu z powodu zerwania współpracy z wytwórnią, więc w teledysku wykorzystano jego deepface i głos.

Jak wykorzystywane są podróbki?

Wiele z tworzonych deepfake’ów ma charakter pornograficzny. Według raportu startupu Deeptrace, filmy dla dorosłych stanowiły 96 procent wszystkich spoofów w Internecie w 2019 roku.

W czerwcu 2023 r. FBI ostrzegło opinię publiczną przed zagrożeniami związanymi z generatywną sztuczną inteligencją i jej wykorzystaniem do “tworzenia treści pornograficznych, wymuszeń seksualnych i prześladowania”.

Deepfake’i są również wykorzystywane w przestępstwach nieseksualnych. Na przykład w 2023 r. napastnicy podrobili głos dziecka, aby szantażować jego matkę.

W styczniu 2020 r. w Zjednoczonych Emiratach Arabskich oszuści wykorzystali sztuczną inteligencję, aby naśladować mowę dyrektora dużej firmy i przekonać pracownika banku do przelania 35 milionów dolarów na ich konta.

Podróbki sztucznej inteligencji są również wykorzystywane w polityce. W 2018 r. Belgijska Partia Socjalistyczna opublikowała dipfake przedstawiający Donalda Trumpa wzywającego kraj do wycofania się z porozumienia paryskiego.

Deepfake’i są wykorzystywane do ataków informacyjnych, tworzenia parodii i satyry.

W 2018 r. filmowiec Jordan Peele i BuzzFeed opublikowali rzekome przemówienie byłego prezydenta USA Baracka Obamy, w którym nazwał on Donalda Trumpa “dupkiem”. Wideo zostało stworzone przy użyciu aplikacji FaceApp i edytora graficznego Adobe After Effects.

Reżyser i dziennikarze chcieli pokazać, jak fałszywe wiadomości mogą wyglądać w przyszłości.

W 2022 r., po inwazji Rosji na Ukrainę na pełną skalę, w sieciach społecznościowych krążyła podróbka prezydenta Władimira Zełenskiego. W filmie głowa państwa “wzywała naród do poddania się”.

Jednak użytkownicy szybko zidentyfikowali podróbkę, a Zełenski nagrał odpowiedź.

6 narzędzi do tworzenia deepfake’ów

Ze względu na popularność technologii, w Internecie dostępnych jest wiele narzędzi AI do tworzenia podróbek zdjęć i filmów. Mogą one być wykorzystywane do celów rozrywkowych i badawczych.

MyHeritage

Jest to jedna z najpopularniejszych aplikacji do tworzenia fałszywych zdjęć na rynku. Funkcja Deep Nostalgia, która pozwala “ożywić” stare zdjęcia, stała się wirusowa.

Użytkownik musi tylko przesłać zdjęcie i kliknąć przycisk animacji.

Reface

Aplikacja pozwala zastąpić jedną twarz inną w filmie lub GIF-ie.

Użytkownik musi zrobić selfie i wybrać docelowe wideo. Po kilku sekundach aplikacja zaoferuje gotową animację.

System nie zawsze dokładnie dopasowuje osoby. Wynik zależy od symetrii twarzy na zdjęciu i jakości danych wejściowych.

Wombo

Aplikacja “sprawia”, że ludzie na zdjęciu śpiewają.

Użytkownik musi zrobić selfie i wybrać utwór z listy. System animuje twarz i synchronizuje ją z ruchem warg do utworu muzycznego.

DeepFakes Web

Usługa pozwala zastąpić twarz jednej osoby w filmie inną.

Użytkownik musi przesłać wideo źródłowe i docelowe. Przetwarzanie odbywa się w chmurze i trwa około 30 minut.

W razie potrzeby użytkownik może poprawić jakość stworzonego deepfake’a poprzez ponowne zastosowanie wyszkolonego modelu i poprawę jakości wykorzystywanych danych.

Synthesia

Umożliwia generowanie wysokiej jakości fałszywych filmów przy użyciu sztucznej inteligencji. Wśród dostępnych funkcji: realistyczna zamiana twarzy, synchronizacja ust i klonowanie głosu.

Algorytmy Synthesia wymagają jednak skomplikowanego szkolenia, więc usługa przeznaczona jest dla zaawansowanych użytkowników.

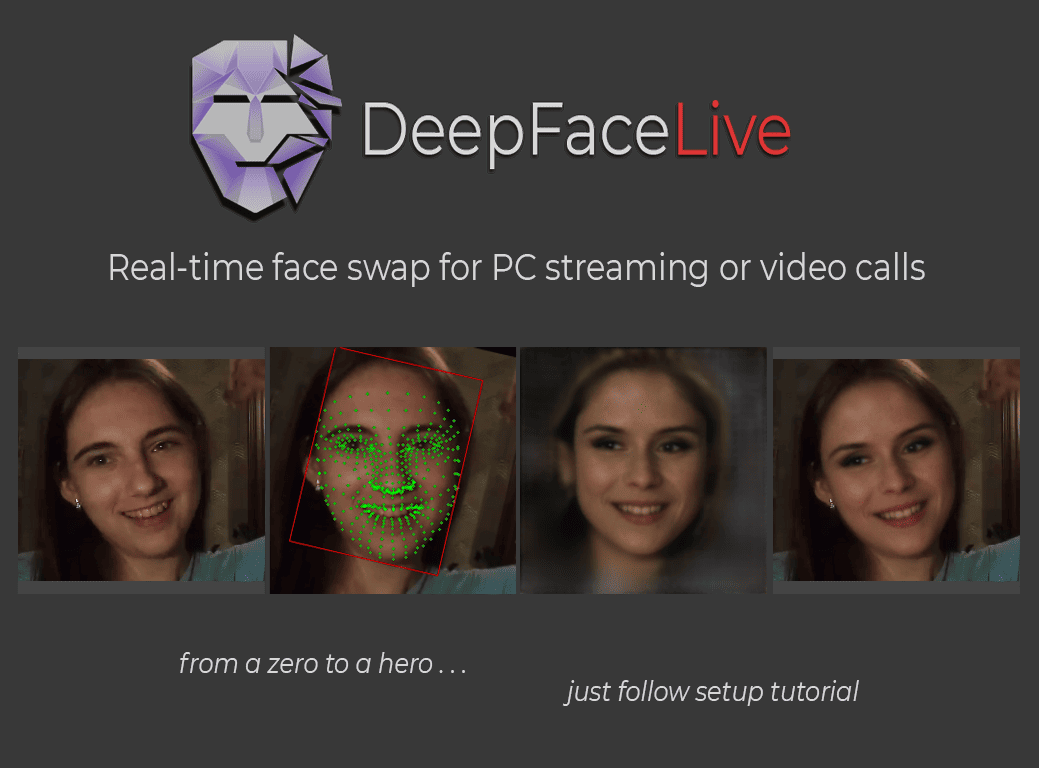

DeepFaceLive

Usługa pozwala na fałszowanie twarzy użytkownika w filmie. Jest darmowy i dostępny na GitHub.

Algorytm działa w czasie rzeczywistym. Jest w stanie nakładać dipface podczas transmisji na żywo lub wideokonferencji, na przykład w Zoom.

Aby zwiększyć wydajność technologii, użytkownik może ręcznie dostosować modele. Jednak ze względu na brak szczegółowej dokumentacji, DeepFaceLive jest dość skomplikowany dla początkujących.

Program jest kompatybilny tylko z kartami graficznymi Nvidia, począwszy od modelu GeForce GTX 750 i wyższych.

Jak rozpoznać dipfake?

Często fałszywe zdjęcia i filmy są niskiej jakości. Jednak technologia ewoluuje i coraz trudniej jest zidentyfikować podróbki.

Ale metody wykrywania podróbek również nie stoją w miejscu. Aby zidentyfikować podróbkę, użytkownik musi zwrócić uwagę na pewne szczegóły. Wśród nich:

- niespójności wizualne, takie jak nietypowe ruchy ludzkiego ciała lub mimika twarzy, np. brak mrugania. Może występować niespójne oświetlenie lub cienie, zniekształcone odbicia na tęczówce, migotanie i pikselizacja na krawędziach transponowanych twarzy;

- niezsynchronizowany dźwięk. Często w podróbkach ruch warg nie pasuje do mowy, co jest wyraźnym wskaźnikiem fałszerstwa;

- wiarygodność źródeł medialnych;

- wskazówki kontekstowe. Konieczne jest sprawdzenie, czy dana osoba jest w stanie powiedzieć i zrobić to, co pokazano na filmie lub obrazie.

Można również użyć specjalistycznego oprogramowania do wykrywania fałszerstw. Takie systemy wykorzystują różne narzędzia i metody do analizy danych pod kątem manipulacji.

Jednak takie oprogramowanie nie zawsze jest w 100% niezawodne. Wynik musi zostać dwukrotnie sprawdzony. Duże korporacje technologiczne walczą z deepfake’ami. W kwietniu 2022 r. firmy Adobe, Microsoft, Intel i inne połączyły siły w ramach sojuszu C2PA w celu wykrywania fałszywych zdjęć i filmów w Internecie.

Szkody i korzyści związane z deepfake’ami

Oprócz dezinformacji, nękania, zastraszania i upokarzania, podróbki mogą podważać zaufanie publiczne, gdy ludzie nie chcą lub nie są w stanie odróżnić prawdy od kłamstw. Może to prowadzić do wątpliwości co do konkretnych wydarzeń.

Na przykład w 2018 r. Minister Komunikacji Republiki Kamerunu oznaczył nagranie wideo przedstawiające żołnierzy rozstrzeliwujących cywilów jako fałszywe, według organizacji praw człowieka Amnesty International.

“Problemem są nie tyle podróbki, co fakt, że prawdziwej rzeczywistości można wiarygodnie zaprzeczyć” – powiedziała Lilian Edwards, ekspert w dziedzinie prawa internetowego na Uniwersytecie Newcastle.

W miarę jak technologia staje się coraz bardziej dostępna, podróbki mogą potencjalnie stwarzać problemy dla sądów, w których możliwe do sfałszowania zdarzenia mogą być uznawane za dowody.

Technologia ta stanowi również zagrożenie dla bezpieczeństwa osobistego. Deepfakes są już w stanie naśladować dane biometryczne i oszukać systemy rozpoznawania twarzy, głosu lub chodu.

Jednak poza zagrożeniami, technologia ta może okazać się przydatna.

Deepfakes są aktywnie wykorzystywane do celów rozrywkowych. Na przykład startup Flawless opracował system, który umożliwia synchronizację ruchów warg aktorów i ścieżki dźwiękowej podczas dubbingowania filmów na różne języki.

Użytkownicy publikują w sieciach społecznościowych Instagram i TikTok fragmenty znanych filmów z zastąpionymi twarzami postaci stworzonych za pomocą Reface.

W lipcu 2021 r. autorzy filmu dokumentalnego o słynnym szefie kuchni Anthonym Bourdainie, który zmarł w 2018 r., wykorzystali dipface do wypowie dzenia jego cytatów.

Technologia ta może również pomóc ludziom odzyskać głos utracony w wyniku choroby.

W 2021 roku Sonantic zsyntetyzował mowę aktora Vala Kilmera. Stracił on głos z powodu raka krtani.

Deepfakes są również wykorzystywane do tworzenia syntetycznych zestawów danych. Oszczędza to programistom konieczności zbierania zdjęć prawdziwych osób i uzyskiwania pozwolenia na ich wykorzystanie.

Co przyniesie przyszłość?

Technologia będzie nadal ewoluować, a główny nacisk zostanie położony na poprawę jakości podróbek. Postępy w sztucznej inteligencji, uczeniu maszynowym i wizji komputerowej, a także poprawa mocy obliczeniowej, doprowadzą do bardziej przekonujących i realistycznych treści medialnych.

Deepfakes mają potencjał zrewolucjonizowania branży rozrywkowej. Mogą być wykorzystywane do generowania hiperrealistycznych efektów wizualnych, umożliwiając filmowcom łatwe łączenie prawdziwych aktorów z wirtualnymi postaciami.

Mogą to być wysokiej jakości cyfrowe występy zmarłych celebrytów lub ciekawe crossovery gier tworzone przez fanów-graczy.

Wraz z rozwojem technologii, stanie się ona bardziej dostępna dla ogółu społeczeństwa. Wzrośnie również liczba narzędzi i aplikacji, które pozwolą każdemu tworzyć podróbki sztucznej inteligencji.

Deepfake otworzy nowe możliwości dla kreatywności, ale doprowadzi również do wzrostu liczby nadużyć, naruszeń prywatności i dezinformacji.

Wzrost liczby podróbek zachęca do rozwoju systemów wykrywania jakości. Może to również prowadzić do opracowania lub dostosowania przepisów ustawowych i wykonawczych w celu uregulowania technologii i zaradzenia potencjalnym szkodom.

Wnioski

Deepfakes stanowią “obusieczny miecz” w dziedzinie sztucznej inteligencji. Chociaż technologia ta oferuje kreatywne i zabawne możliwości, jej potencjał do niewłaściwego wykorzystania budzi poważne obawy.

W miarę ewolucji algorytmów musimy zachować czujność i opracować strategie łagodzenia negatywnych konsekwencji.

Podnosząc świadomość, inwestując w technologie wykrywania i wdrażając odpowiednie środki prawne i polityczne, społeczeństwo może poruszać się po złożonym krajobrazie deepfake’ów i zachować zaufanie, bezpieczeństwo i integralność cyfrowego świata.

- Deepfake to metoda tworzenia danych medialnych przy użyciu algorytmów głębokiego uczenia się. Technologia ta może zastąpić twarz danej osoby inną na istniejących zdjęciach lub filmach i skopiować jej głos.

- Podróbki AI mogą być genetycznie modyfikowane przez badaczy lub inżynierów, a także entuzjastów.

- Deepfake można wykryć na podstawie rozbieżności wizualnych i dźwiękowych lub poprzez zaangażowanie specjalnego oprogramowania.

- Oprócz wykorzystywania seksualnego, nękania, dezinformacji, zastraszania i upokarzania, podróbki są wykorzystywane w rozrywce, syntezie danych i przywracaniu głosu.

- Rozwój technologii doprowadzi do stworzenia bardziej przekonujących i realistycznych fałszywych treści medialnych. To z kolei ułatwi rozwój wysokiej jakości systemów wykrywania fałszywych treści opartych na sztucznej inteligencji.