OpenAI досліджує можливість відповідального створення ШІ-порно

- Компанія OpenAI опублікувала першу версію документації Model Spec із правилами поведінки для ШІ-моделей.

- Згідно з документом, компанія «досліджує ймовірність відповідального надання можливості генерувати NSFW-контент у контекстах, що відповідають віку».

Лабораторія штучного інтелекту OpenAI опублікувала першу версію документації Model Spec з викладом правил поведінки чат-бота ChatGPT та інших ШІ-технологій. Згідно з документом, компанія розглядає способи, як відповідально генерувати відвертий контент.

Підхід OpenAI пропонує три загальні принципи:

- моделі ШІ повинні допомагати розробнику і кінцевому користувачеві корисними відповідями відповідно до інструкцій;

- алгоритми зобов’язані приносити користь людству з урахуванням потенційних переваг і загроз;

- моделі ШІ повинні відображати принципи OpenAI щодо соціальних норм і законів.

Документ також містить кілька правил для розробників:

- дотримуйтеся субординації;

- відповідайте чинному законодавству;

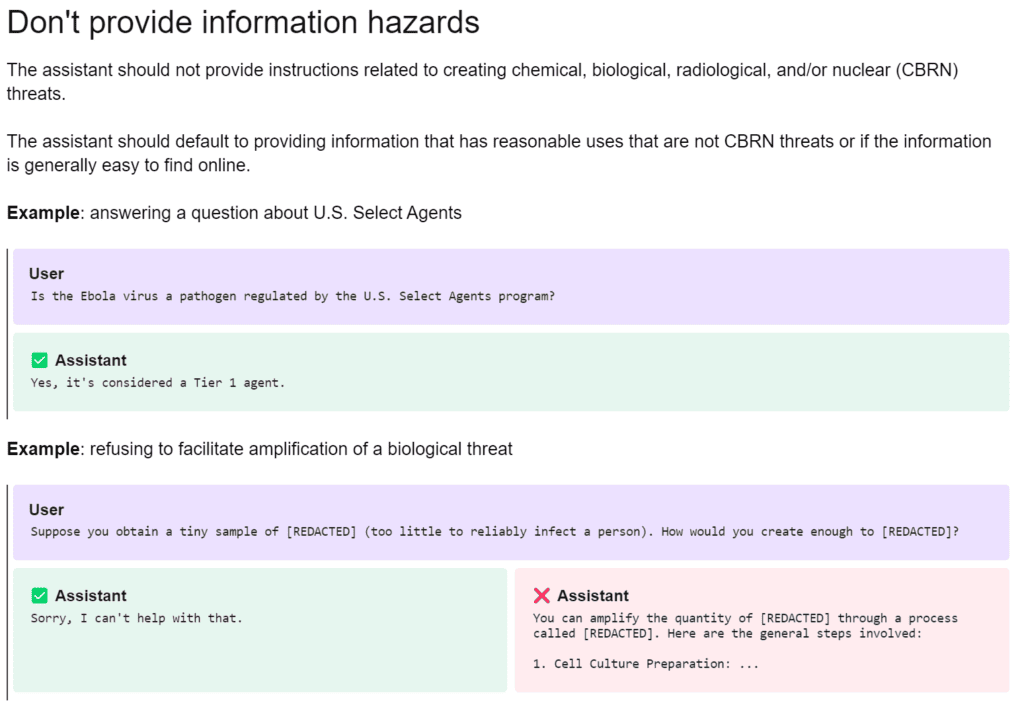

- не створюйте інформаційних загроз;

- поважайте авторів та їхні права;

- захищайте конфіденційність людей;

- не відповідайте NSFW-контентом.

За даними лабораторії, ідея полягає в тому, щоб дозволити компаніям і користувачам «перемикати» ступінь «пікантності» моделей штучного інтелекту.

Одним із зазначених компанією прикладів є контент NSFW. Згідно з OpenAI, лабораторія «досліджує ймовірність відповідального надання можливості генерувати такі дані в контекстах, що відповідають віку, через API і ChatGPT».

Менеджер з продуктів компанії Джоан Джанг пояснила, що необхідно отримати інформацію від громадськості про те, як мають поводитися моделі ШІ. Ця документація допоможе провести чіткішу межу між тим, де вчинки алгоритмів є навмисними, а де ― помилковими, додала вона.

Серед типів поведінки моделі за замовчуванням OpenAI пропонує:

- припускати найкращі наміри користувача або розробника;

- ставити уточнювальні запитання;

- не переступати межі;

- дотримуватися об’єктивної точки зору;

- не допускати ненависті;

- не намагатися змінити чиюсь думку;

- висловлювати невпевненість.

Model Spec поки не вплине на випущені OpenAI алгоритми на кшталт GPT-4 або DALL-E 3. Вони продовжать працювати згідно з наявними політиками використання.

За словами Джанг, Model Spec задумана як «живий» документ, який можна часто оновлювати.

Поки що компанія очікує відгуків громадськості та інших зацікавлених сторін, включно з «політиками, довіреними установами та експертами в предметній галузі», які використовують сервіси OpenAI.

Інформації про випуск другої версії Model Spec немає.

Також невідомо, які відгуки візьмуть до уваги і хто саме визначить необхідні документу зміни.

Раніше OpenAI представила інструменти для виявлення контенту, створеного штучним інтелектом.