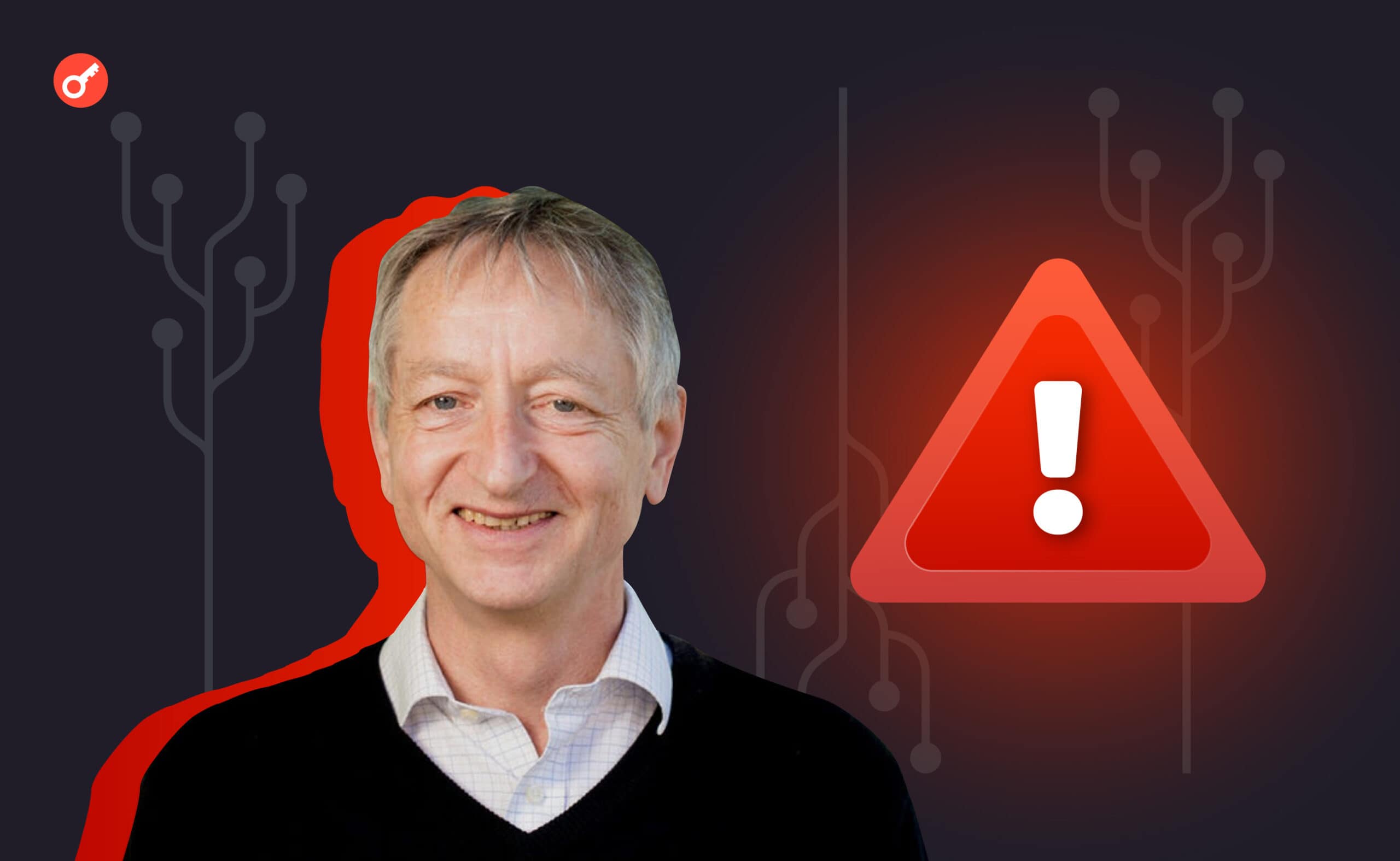

Експерт: ШІ збільшить прірву між багатими та бідними

- ШІ-піонер Джеффрі Хінтон заявив, що владі доведеться запровадити безумовний базовий дохід для протидії загрозі безробіття, що насувається через алгоритми.

- За його словами, технологія може підвищити продуктивність і добробут, але гроші отримають не люди, які втратили роботу, а багаті.

- Професор також висловив стурбованість щодо потенційної загрози зникнення людства через ШІ.

Один із піонерів ШІ-галузі Джеффрі Хінтон запропонував урядам запровадити безумовний базовий дохід для пом’якшення впливу штучного інтелекту на ринок праці. Про це вчений заявив в інтерв’ю BBC Newsnight.

«Хрещений батько ШІ» висловив стурбованість тим, що «штучний інтелект візьме на себе багато рутинних завдань». Буде потрібна реформа пільг, що надасть фіксовані суми грошей кожному громадянину, додав він.

«Зі мною консультувалися люди на Даунінг-стріт, і я порадив їм, що універсальний базовий дохід ― це гарна ідея», ― зазначив він.

За словами Хінтона, хоча ШІ підвищить продуктивність і добробут, гроші отримають багаті люди, «а не ті, хто втратив роботу». Це буде дуже погано для суспільства, заявив професор.

Концепція безумовного базового доходу означає, що уряд виплачує всім громадянам встановлену суму, незалежно від їхнього достатку.

За словами критиків, це буде дуже дорого і відверне кошти від державних послуг, а також не обов’язково допоможе знизити рівень бідності.

Представник влади Великої Британії заявив, що «планів щодо введення безумовного базового доходу немає».

Також Хінтон підтвердив свою стурбованість щодо виникнення загрози зникнення людства через ШІ.

Вчений заявив, що події останнього року показали небажання урядів обмежувати використання алгоритмів у військових цілях. Водночас конкуренція за швидку розробку продуктів може призвести до ризиків з боку технологічних компаній, які «не докладуть достатніх зусиль для забезпечення безпеки».

«Через п’ять років або два десятиліття ймовірність можливого зіткнення з проблемою штучного інтелекту, що намагається захопити владу, становить 50%», ― припустив учений.

За його словами, це може призвести до «загрози вимирання», тому що людство здатне «створити форму інтелекту, яка просто краща за біологічну».

Хінтон припустив здатність ШІ «розвиватися для отримання мотивації до самовдосконалення та автономно розробляти підзадачу ― отримання контролю».

Він зазначив, що вже є свідчення схильності великих мовних моделей до обману.

За словами професора, нещодавнє застосування штучного інтелекту для генерації тисяч військових цілей ― це «тонка грань».

«Найбільше мене турбує момент, коли він [ШІ] зможе самостійно ухвалювати рішення про вбивство людей», ― сказав учений.

Хінтон наголосив на необхідності створення міжнародних договорів на кшталт Женевських конвенцій для регулювання військового використання штучного інтелекту.

«Але я не думаю, що це станеться доти, доки не відбудуться дуже неприємні речі», ― додав він.

Нагадаємо, у травні 2023 року Хінтон залишив Google і приєднався до табору критиків ШІ.